Recientemente se han abierto muchos debates sobre los beneficios y los peligros de la Inteligencia Artificial. Con toda la popularidad que han ganado plataformas como Midjourney (para crear imágenes en Inteligancia Artificial) o ChatGPT (para conversar, generar textos y prácticamente cualquier cosa), la industria creativa ha puesto el grito en el cielo y han visto cómo peligran sus trabajos. ¿Pero ese es todo el riesgo que ofrece la inteligencia artificial? En todo caso, ¿por qué Elon Musk, Steve Wozniack y al menos otros mil tecnócratas prefieren que le pongamos un alto a todo esto?

¿Por qué Elon Musk y Steve Wozniak quieren frenar a ChatGPT?

Precisamente por lo que estás pensando, sin exageración. En una carta firmada por cientos de expertos en el desarrollo de la tecnología inteligente, se pide a los programadores que cesen de “enseñarle” cosas a la IA, pues las consecuencias de continuar con esta labor sin freno podrían ir desde la pérdida de empleos por parte de varios sectores de la población, hasta la sustitución completa de la humanidad.

“Pedimos a todos los laboratorios de inteligencia artificial que suspendan inmediatamente durante al menos 6 meses el entrenamiento de sistemas de IA más potentes que GPT-4 (incluido GPT-5, que se está entrenando actualmente)”

También se ha pedido que este freno sea público y verificable. Es decir, que los laboratorios no digan que ya se detuvieron pero que los bots continúen sirviendo con normalidad. Y que en caso de que alguno de ellos se niegue a detenerse, se pide a los gobiernos del mundo que intervengan. La carta ha sido firmada por un millar de científicos, entre los que destacan Yoshua Bengio (considerado pionero de la inteligencia artificial moderna), Steve Wozniak (creador de la primera máquina Apple, Yuval Noah Harari (un historiador), Jaan Tallinn (cofundador de Skype) y Elon Musk, que no requiere de más presentaciones.

¿La IA podría ser peligrosa para el mundo?

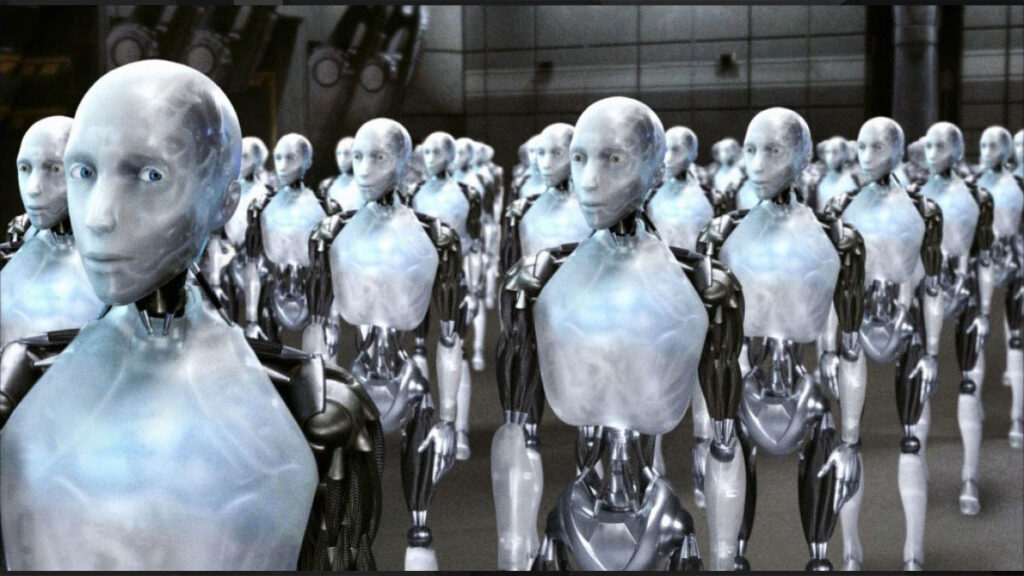

Probablemente no al grado que en las películas, como para fabricar robots que nos aniquilen, pero sí en un escenario distinto pero igual de catastrófico. Hemos puesto demasiadas cosas vitales en manos de la Inteligencia Artificial, pero hay una que estos científicos consideran que es la más peligrosa de todas: la Información. Con la velocidad a la que se comparte esta por Internet, la IA podría, sin ningún problema, comenzar a divulgar información falsa (como la supuesta foto de un tiburón blanco encallado, que es completamente creada por IA) y la gente la creería sin más.

Los peligros son principalmente económicos, contrario a lo que se pensaría. Si se automatizan todos los empleos, es verdad que los empresarios ahorrarán en salarios, ¿pero de dónde sacará la población su poder de consumo si no hay trabajo? La sociedad podría modificarse en escalas que aún no podemos imaginar, así que la petición de esta carta no es cosa menor.

¿Se puede frenar el avance de la IA en el mundo?

La pregunta no es si aún es posible, sino si deberíamos hacerlo. Microsoft y Google son los principales exponentes en esta “carrera de la IA” que han comenzado a buscar perfeccionar cada vez más el trabajo de la Inteligencia Artificial. Su inversión supera ya los 10 mil millones de dólares en desarrollo, y no han respondido todavía a la carta. Seguramente ofrecerán una gran resistencia a hacerlo.

Por supuesto que se podría detener su avance en este momento, como el profesor Peter Stone de la Universidad de Austin quien asegura que este desarrollo y crecimiento fue tan rápido que “el público apenas y tuvo tiempo de conocerlo”. Ponerle un freno en este momento le impediría al público en general encontrar todas las virtudes y ventajas que la IA podría ofrecer.

¿ChatGPT es la única inteligencia artificial en el mundo?

Por supuesto que no. Pero sí es la más potente en estos momentos, principalmente por su algoritmo de aprendizaje. OpenAI (la empresa creadora de ChatGPT) lleva trabajano en esta tecnología desde febrero de 2019, cuando lanzó GPT-2. Muchas otras tecnologías de IA son utilizadas diariamente en nuestro día a día (como el autocorrector de Whatsapp o el reconocimiento facial de los sistemas de seguridad de redes sociales). Pero ninguna tan poderosa como GPT hasta ahora.

Microsoft lanzó a principios de marzo Kosmos-1, su propio modelo de Inteligencia Artificial y con el que intenta competir en esta carrera, y esa prisa por tratar de ganar el mercado es lo que podría hacer que su desarrollo se saliera de control, pues a la Inteligencia Artificial le falta un “criterio Artificial”, pues al sólo repetir lo que aprende, muchas veces cae en falacias, errores de información, prejuicios humanos y otra serie de problemas de sus mismos creadores.

Habrá que esperar para ver qué responden los laboratorios a esta carta, y en todo caso, observar en qué panorama queda la Inteligencia Artificial en el panorama futuro… uno no muy lejano, digamos… ¿dónde estaremos a finales de 2023?

eSports

Ya te tocaba, carnal: ¡Oficialmente la E3 fue CANCELADA!

eSports

Estos son los juegos que llegarán gratis a PlayStation Plus en abril de 2023